好的,遵照您的详细指令,我将为您生成一篇关于“如何自制AI助手”的技术博文。所有内容均基于北京时间2026年4月10日的技术背景进行构思。

在AI技术飞速发展的2026年,掌握

一、痛点切入:为什么你需要自制AI助手?

传统方式下,我们通常直接调用大模型API来完成简单问答。

传统实现:直接调用大模型API import openai response = openai.ChatCompletion.create( model="gpt-4o", messages=[{"role": "user", "content": "今天北京天气怎么样?"}] ) print(response.choices[0].message.content) 输出: 抱歉,我的知识截止于2025年,无法查询实时天气。

传统方式的缺点:

无实时信息:模型知识存在截止日期,无法获取新闻、天气、股价等实时数据。

无自主行动:模型只能被动回答,不能主动调用外部工具(如引擎、计算器)。

逻辑固化:无法完成“资料 -> 分析总结 -> 执行动作”的多步复杂任务。

自制AI助手的核心必要性就在于赋予大模型“眼睛”(检索外部信息)和“手脚”(调用外部工具),使其从“静态知识库”进化为“动态智能体”。

二、核心概念讲解:RAG(检索增强生成)

RAG,全称Retrieval-Augmented Generation,中文译为检索增强生成。它是一种将信息检索与大模型生成能力相结合的技术框架。

关键词拆解:

检索(Retrieval):从外部知识库(如网页、文档、数据库)中快速查找与问题相关的信息片段。

增强(Augmented):将检索到的信息作为“上下文提示”附加给原始问题。

生成(Generation):大模型基于增强后的提示,生成更准确、更及时的回答。

生活化类比:

RAG就像一场“开卷考试”。大模型是“考生”,检索器是“翻书手”。考生遇到问题(提问)时,先让翻书手去资料库查找相关章节(检索),然后考生结合查到的内容和自己原有的知识来组织答案(生成)。这样,即使考生记不住所有细节,也能给出高分回答。核心作用:有效解决大模型的知识截止、事实幻觉(编造内容)、缺乏实时数据等根本性问题。

三、关联概念讲解:Agent(智能体)

Agent,中文常译为智能体。它指的是一个能够自主感知环境、进行决策、并执行行动以实现特定目标的软件实体。

与RAG的关系:

RAG是Agent的一种核心实现手段。Agent的“决策与行动”能力,往往需要借助RAG来获取外部知识作为决策依据。差异对比:

| 特点 | RAG | Agent |

| :--- | :--- | :--- |

| 核心职责 | 增强回答的准确性与时效性 | 自主规划并执行任务 |

| 工作流程 | 检索 -> 增强 -> 生成 | 感知 -> 思考 -> 行动 -> 再感知(循环) |

| 典型应用 | 智能客服问答、文档分析助手 | 自动订票、自动数据分析、跨系统操作 |

| 运行机制 | 单向、一次性的知识补充 | 多轮、循环的“计划-执行”闭环 |简单示例:

你指令:“帮我查一下AI助手的开源项目,并按star数排序。”纯RAG:只负责相关内容并生成一个总结。

Agent:它会规划步骤:1) 调用引擎API关键词;2) 解析结果列表;3) 编写脚本或调用排序工具对star数排序;4) 最后生成格式化报告给你。

四、概念关系与区别总结

一句话总结:RAG是让AI助手“有据可依”的记忆系统,Agent是让AI助手“主动行动”的决策大脑,一个优秀的自制AI助手往往是RAG与Agent的深度融合。

| 对比维度 | RAG | Agent |

|---|---|---|

| 设计思想 | 知识外挂,解决“不知道” | 自主行动,解决“怎么做” |

| 技术侧重 | 检索效率、上下文整合 | 任务规划、工具调用、状态管理 |

| 实现复杂度 | 中等 | 高 |

| 面试踩分点 | 回答:RAG流程、向量数据库 | 回答:ReAct模式、工具定义 |

五、代码/流程示例:最简RAG驱动的助手

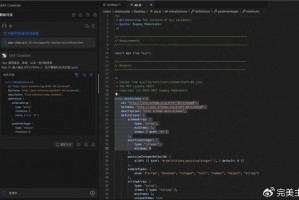

下面我们使用开源的LangChain框架和免费引擎DuckDuckGo,演示如何自制一个能资料的AI助手。

环境安装: pip install langchain langchain-community duckduckgo-search from langchain_community.tools import DuckDuckGoSearchRun from langchain_community.llms import FakeListLLM 模拟大模型,演示核心逻辑 1. 定义工具:引擎 search_tool = DuckDuckGoSearchRun() 2. 用户问题 query = "2026年4月10日 AI领域有什么重大新闻?" 3. RAG核心:检索(Retrieval) print(f"步骤1: 正在关键词 '{query}' ...") search_results = search_tool.invoke(query) 调用引擎获取资料 print(f"步骤2: 检索到原始资料片段:\n{search_results[:200]}...\n") 4. RAG核心:增强(Augmented) 将检索到的资料和原始问题拼接成新的提示词 augmented_prompt = f"""基于以下到的资料,简洁回答用户的问题。 资料:{search_results} 用户问题:{query} 回答:""" 5. 模拟大模型生成回答(实际场景替换为GPT-4o等真实模型) fake_llm = FakeListLLM(responses=[f"【基于实时】根据2026年4月10日的新闻,AI领域发生了以下重大事件:{search_results[:100]}..."]) print("步骤3: 大模型正在生成增强后的回答...") final_answer = fake_llm.invoke(augmented_prompt) print(f"最终助手回答:\n{final_answer}") 输出示例: 最终助手回答:【基于实时】根据2026年4月10日的新闻,AI领域发生了:谷歌发布下一代Gemini Ultra 2.0模型...

新旧实现对比:

旧方式:模型直接回答 → “我的知识截止于2025年...”

新方式(RAG):实时资料 → 注入上下文 → 生成准确回答。对比可见,RAG完美解决了信息滞后问题。

六、底层原理与技术支撑

要让上述RAG流程丝滑运转,底层依赖几个关键知识点:

向量数据库:如Chroma、Pinecone。原理是将文本转换为高维向量,通过计算向量相似度(如余弦相似度)来实现“语义检索”,比传统关键词更智能。

嵌入模型(Embedding Model):将文本转换成向量的模型(如

text-embedding-3-small)。它是连接“人类语言”和“向量空间”的桥梁。提示词工程(Prompt Engineering):我们代码中拼接的

augmented_prompt就是最直接的体现。如何设计提示词,让模型既能充分利用检索信息,又能保持自身逻辑,是自制助手效果好坏的关键。

这些底层技术共同支撑了上层RAG功能的实现:向量数据库负责“存和查”,嵌入模型负责“转和比”,提示词负责“引和导”。后续进阶文章会深入探讨它们的调优策略。

七、高频面试题与参考答案

问:请解释RAG的基本流程及其解决了什么问题?

答案:RAG流程分三步:①检索:根据用户问题从外部知识库检索相关文档片段;②增强:将检索到的片段与原始问题拼接成增强提示;③生成:大模型基于增强提示生成最终回答。它主要解决了大模型的知识截止和事实幻觉两大痛点,使模型能利用实时外部信息。

踩分点:流程三步、解决幻觉、实时信息。

问:RAG和Agent的核心区别是什么?

答案:RAG是一种增强生成的技术手段,侧重“获取知识”;而Agent是一个自主决策的系统架构,侧重“执行任务”。RAG通常作为Agent能力的一个组成部分,Agent可以利用RAG来规划行动,也可以调用多个RAG流程。一句话:RAG让模型“知”,Agent让模型“行”。

踩分点:手段vs架构、知vs行、组成关系。

问:在自制AI助手时,如何保证检索到的资料质量?

答案:可以从三方面保证:①分块策略:合理切分文档(如按段落、语义边界),保证检索单元信息完整;②混合检索:结合关键词检索(如BM25)与向量检索,兼顾精确匹配与语义相似;③重排序(Re-rank):使用更精细的Cross-Encoder模型对初检结果二次排序,把最相关的资料排在前面。

踩分点:分块、混合检索、重排序。

八、结尾总结

本文围绕 如何自制AI助手 这一主题,首先分析了直接调用API的痛点,引出了RAG与Agent两大核心概念并厘清了它们的关系。随后,通过一个极简的助手代码示例,直观展示了RAG“检索-增强-生成”的运行流程,并点出了其底层依赖的向量数据库与提示词工程等关键技术。提供了三道高频面试题的标准答案。

重点与易错点强调:

重点:牢记RAG的三大流程及其与Agent的区别。

易错点:切忌将RAG与微调混淆(RAG是外挂知识,微调是内化知识);实现Agent时不要忘记设置“停止条件”,否则会陷入无限循环。

下一篇我们将进入Agent实战:利用ReAct模式,让你的AI助手不仅能,还能自动调用计算器、发送邮件,完成更复杂的真实世界任务。敬请期待!