夸克AI助手2026深度解析:从AI搜索到“超级框”的技术跃迁

一、开篇引入

北京时间2026年4月9日。 在AI大模型浪潮席卷各行各业的今天,“AI”早已不是新鲜词,但夸克AI助手的进化路径,却走出了一条区别于传统AI工具的独特道路。从最初的内置千问助手,到如今的“AI超级框”全面升级,夸克正在重新定义“浏览器+AI助手”这一组合的技术逻辑与用户体验。

很多开发者在使用AI工具时,往往陷入这样的困境:只会用、不懂原理、概念易混淆、面试答不出。 为什么夸克AI助手能在众多AI浏览器中脱颖而出?“AI超级框”背后的技术架构是什么?夸克大模型与千问助手之间究竟是什么关系?这些问题,正是本文要一一拆解的核心。

本文将围绕夸克AI助手的技术体系,从痛点切入→核心概念→底层原理→代码示例→面试考点,带你建立完整知识链路。

二、痛点切入:为什么需要夸克AI助手这样的“AI”?

在夸克AI助手出现之前,传统和浏览器辅助工具存在以下问题:

传统流程示例:

传统伪代码示例 def traditional_search(query): 步骤1:手动输入关键词 keywords = extract_keywords(query) 人工提取关键词 步骤2:在多个网页间跳转阅读 results = search_engine.search(keywords) for page in results: content = page.read() 步骤3:人工逐页阅读、总结、复制粘贴 summary = manually_summarize(content) 耗时且低效 步骤4:切换到其他工具处理信息 return copy_to_other_app(summary) 频繁切换应用

传统方案的四大痛点:

耦合性高:、阅读、总结、输出需要在不同应用间切换,信息链路断裂

扩展性差:想要增加“智能总结”功能,需要额外安装插件或使用独立AI工具

维护成本高:多个工具之间的数据流转依赖手动复制粘贴,极易出错

效率瓶颈:用户需要主动思考如何提问、提取关键词,AI只是被动响应

夸克AI助手的解决思路:

夸克以阿里Qwen大模型为核心,将AI能力深度嵌入浏览器的每一个环节——不再是“浏览器+AI插件”的简单叠加,而是让AI成为浏览器的“原生操作系统”-19。用户只需在一个“AI超级框”中输入指令,夸克智能中枢就能自动识别意图、规划任务路径、调动不同模型和Agent模块完成工作-1。

三、核心概念讲解:夸克大模型

标准定义

夸克大模型(Quark Large Model) :阿里巴巴智能信息事业群于2023年11月14日发布的一款千亿级参数多模态大模型,基于Transformer架构,具备AIGC(AI生成内容)和智能检索能力-31。

拆解关键词

千亿级参数:指模型内部的神经元连接权重数量达到千亿级别,参数规模决定了模型的表达能力

多模态:模型能同时处理文字、图片、语音等多种形式的信息输入

Transformer架构:2017年Google提出的深度学习架构,通过“自注意力机制”捕捉文本中的长距离依赖关系,是大语言模型的标准技术底座

生活化类比

想象一个“全能知识管家”——你给它看一篇文章,它能总结核心要点;你问它一道数学题,它能分步推导;你说一句口语,它能润色成学术表达。夸克大模型就是这样一个“管家”的大脑,而夸克AI助手则是它与你交互的“嘴和手”。

作用与价值

夸克大模型主要应用于、生产力工具和资产管理助手三大领域-31。其核心价值在于:将传统“引擎”从“关键词匹配”升级为“语义理解+任务执行”的智能中枢。

四、关联概念讲解:千问助手

标准定义

千问助手(Qwen Assistant) :基于阿里Qwen大模型构建的内置AI助手,是夸克AI浏览器的核心智能中枢。用户可通过读屏、快捷框、侧边栏、悬浮球、划词、截屏等多种方式随时调用-4。

它与夸克大模型的关系

| 概念 | 角色定位 | 技术层级 |

|---|---|---|

| 夸克大模型 | 底层基座(大脑) | 模型层 |

| 千问助手 | 上层应用(交互界面) | 应用层 |

一句话概括:夸克大模型是“发动机”,千问助手是“方向盘+仪表盘” 。大模型提供推理和生成能力,千问助手负责将这种能力以用户友好的方式呈现出来。

运行机制示例

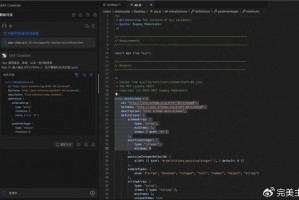

千问助手调用夸克大模型的简化流程 class QwenAssistant: def __init__(self): self.model = QuarkLargeModel() 底层夸克大模型 self.toolkit = QwenToolkit() 套件:侧边栏/划词/截屏等 def process_user_input(self, query, context): 步骤1:通过套件获取用户意图和上下文 intent = self.toolkit.capture_intent(query, context) 步骤2:调用夸克大模型进行推理 reasoning = self.model.reason(intent) 步骤3:智能中枢规划任务路径 plan = self.intelligent_center.plan(reasoning) 步骤4:执行任务并返回结果 return self.execute(plan)

千问助手的核心创新在于:它不只在大模型中“跑”一次就结束,而是采用“实时检索+信源追溯+交叉验证”的三层机制——用户提问后,AI自动调用夸克的垂直领域知识库并标注信息来源,避免“幻觉内容”-36。

五、概念关系与区别总结

| 维度 | 夸克大模型 | 千问助手 | 夸克AI浏览器 |

|---|---|---|---|

| 本质 | 底层技术基座 | 上层AI服务 | 产品载体 |

| 类比 | 大脑 | 语言能力+行为习惯 | 身体 |

| 职责 | 推理、生成、理解 | 交互、调用、执行 | 承载、呈现、集成 |

| 依赖关系 | 被依赖 | 依赖大模型 | 集成两者 |

一句话记忆: 夸克大模型是“会思考的大脑”,千问助手是“会说话的嘴巴”,夸克浏览器是“有行动力的身体”——三者合一,才构成完整的夸克AI助手体验。

六、代码/流程示例演示

传统 vs 夸克AI助手

传统方式:

// 传统:需要手动拆分任务、多步操作 // 用户:想了解“2026年AI芯片市场趋势” // 步骤1:在引擎输入关键词 search("2026 AI芯片 市场趋势") // 返回10+篇独立文章 // 步骤2:逐篇阅读、手动总结 for each article in results: summary = manually_extract_key_points(article) // 人工操作 // 步骤3:粘贴到文档中整合 document.paste(summary)

夸克AI助手方式:

// 夸克AI助手:一句话搞定全流程 // 用户在“AI超级框”中输入自然语言指令 function quarkAISearch(user_query) { // 步骤1:意图识别(智能中枢自动完成) let intent = IntelligentCenter.recognizeIntent(user_query); // 用户query = "帮我总结2026年AI芯片市场趋势,输出PPT大纲" // intent = { type: "research_summary", output_format: "ppt_outline" } // 步骤2:模型路由(按需分配) let model = ModelRouter.select(intent); // 涉及深度推理 → 路由到 Qwen3-Max-Thinking 模型 // 步骤3:任务执行 let result = model.execute(intent); // AI自动:检索信息 → 整合分析 → 提取关键点 → 生成PPT大纲 // 步骤4:结构化输出 return format_output(result, intent.output_format); // 返回可直接使用的PPT大纲,支持一键导出 }

夸克AI助手支持在首页一次性上线多个模型,用户可自由选择——写代码时切换到Qwen3-Coder,啃论文时切换到Qwen3-Max-Thinking,实现“按需分配大脑”-12。

千问套件调用示例

千问六大套件调用方式 class QwenToolkit: 1. 划词:选中文本后一键总结/翻译/润色 def on_text_selection(self, selected_text): return self.ai.summarize(selected_text) 2. 截屏:截图后AI识别并分析 def on_screenshot(self, image): return self.ai.analyze_image(image) 3. 侧边栏:边浏览边对话 def sidebar_chat(self, webpage_context, user_question): return self.ai.chat_with_context(webpage_context, user_question) 4. 读屏:自动捕捉屏幕内容变化并主动提问 def screen_reading_auto_mode(self, screen_content): 新增的“自动提问”模式,无需手动触发 return self.ai.proactive_question(screen_content)

六大套件把用户在浏览器里的每一次操作,都直接转化为大模型可理解的上下文,告别复制粘贴和频繁应用切换-12。

七、底层原理与技术支撑

夸克AI助手的能力建立在以下核心技术之上:

1. Transformer架构与自注意力机制

夸克大模型基于Transformer架构,其核心是自注意力机制(Self-Attention) :模型在处理一个词时,会“关注”句子中所有其他词,计算它们与当前词的相关程度,从而理解上下文语义。这就像人读一句话时,大脑会自动关联前后的词语来理解整句意思。

2. MoE(混合专家)架构

千问大模型采用MoE(Mixture of Experts)架构——以千亿级参数规模的大模型为例,虽然总参数量庞大,但每次推理只激活其中约17B(百亿级)参数-。这种设计的优势在于:用更少的计算资源完成推理任务,在不牺牲性能的前提下降低算力成本。

3. 多模态融合

夸克大模型支持文字、图片、语音、截图等多种输入形式-17。这背后依赖跨模态对齐技术——将不同模态的信息映射到统一的语义空间中,让模型理解“图片中的猫”和“文字描述的猫”是同一个概念。

4. “AI超级框”智能中枢

2025年3月,阿里巴巴正式推出AI旗舰应用“新夸克”,核心架构是“AI超级框”——用户在框中输入指令后,智能中枢自动识别意图,规划梳理后调动各种不同模型和Agent模块完成任务-1。这相当于在用户与大模型之间建立了一个“任务调度层”,让AI真正从“对话”走向“执行”。

5. 三层验证保障机制

千问助手采用“实时检索+信源追溯+交叉验证”的三层验证机制,确保输出信息的可靠性-36。例如,当用户询问专业问题时,AI会自动调用夸克的垂直领域知识库,并在回答中标注信息来源,避免“幻觉内容”。

八、高频面试题与参考答案

面试题1:夸克AI助手与普通AI工具的核心区别是什么?

参考答案:

核心区别在于深度融合程度。普通AI工具大多是“引擎+AI对话框”的简单拼接,用户在框外需要额外调用AI功能。而夸克AI助手将AI能力原生嵌入浏览器的每一个环节——从框到阅读、文档处理、视频播放,AI都是原生能力而非附加插件-19。夸克还推出了“千问六大套件”(划词、截屏、侧边栏、读屏、悬浮球、快捷框),覆盖用户的全链路操作场景。

踩分点:融合深度 vs 插件模式、原生能力 vs 附加功能、全链路覆盖

面试题2:夸克大模型与千问助手是什么关系?

参考答案:

两者是基座与应用的层级关系。夸克大模型是阿里巴巴自研的千亿级多模态大模型,是底层技术基座;千问助手是基于该大模型构建的上层AI应用,负责与用户交互、调用模型能力-31-4。打个比方:夸克大模型是“发动机”,千问助手是“方向盘”,夸克浏览器是“车身”——三者结合才构成完整产品。

踩分点:基座 vs 应用、层级关系、三者的协作

面试题3:夸克AI助手的“AI超级框”架构解决了什么问题?

参考答案:

“AI超级框”解决了传统AI工具的两个痛点:①多应用切换 和 ②任务链路断裂。用户在一个输入框中输入自然语言指令后,夸克智能中枢自动完成意图识别→模型路由→任务规划→执行→输出,无需在不同工具间切换。这本质上是将“对话式AI”升级为“任务式AI”——从回答一个问题,变成完成一个任务-1。

踩分点:意图识别、模型路由、任务规划、从对话到任务

面试题4:夸克AI助手如何保证回答的准确性和可靠性?

参考答案:

千问助手采用 “实时检索+信源追溯+交叉验证”的三层验证机制。当用户提问后,AI首先调用夸克的垂直领域知识库获取权威信息,并在回答中标注信息来源;同时,对于关键结论会进行多源交叉验证,避免单一信源的偏差。夸克AI助手支持“深度”模式和“逻辑链可视化”,用户可追溯AI的推理过程-36。

踩分点:三层验证、信源追溯、深度、推理可追溯

面试题5:夸克AI助手的技术架构中,MoE(混合专家)机制的作用是什么?

参考答案:

MoE机制的核心作用是在保证模型性能的前提下降低计算成本。千问大模型采用MoE架构,虽然总参数量达到千亿级,但每次推理只激活其中约170亿参数-。这意味着模型既拥有大型模型的理解能力,又在运行时保持较低的算力消耗,从而在PC端和移动端都能流畅运行。

踩分点:参数激活策略、性能与成本的平衡、端侧部署

九、结尾总结

核心知识点回顾

夸克大模型:阿里巴巴自研千亿级多模态大模型,基于Transformer架构,是夸克AI助手的技术基座

千问助手:基于夸克大模型构建的上层AI服务,通过六大套件实现全链路覆盖

AI超级框:夸克AI助手的核心交互形态,将“对话式AI”升级为“任务式AI”

MoE架构:千问大模型的核心技术,在保证性能的前提下降低计算成本

三层验证机制:保障AI回答准确性的核心技术方案

重点与易错点

易混淆点:不要把“夸克大模型”和“千问助手”当成同一回事——一个是底层模型,一个是上层应用

易忽略点:夸克AI助手的核心竞争力不在于单一模型有多强,而在于“AI超级框”的任务调度能力和六大套件的全链路覆盖

面试提醒:面试中提及AI浏览器时,可以对比“插件模式”与“原生融合模式”的差异,这往往是区分理解深度的关键

下篇预告

下一篇将深入解析夸克AI助手的“千问智能套件”底层实现原理,包括划词功能的上下文捕捉机制、读屏自动提问模式的技术方案,以及如何通过Agent模块实现跨应用任务调度,敬请期待。