懒人经济学:2026年的语音助手,到底香不香?

开车开到120,突然想去的目的地变了,单手扶着方向盘,还得提心吊胆地低头打字输入导航。那一刻,我特想爆粗口。手机里那个AI语音助手智能助手倒是醒着,可我跟它说“去上次那家火锅店”,它回我一句“未找到去‘上次’的路线”。得,一句话给我整不会了。要不是旁边坐着人,我恨不得冲它喊一声:“你能不能聪明点?”

这就是我每天的真实感受。自从换了新车和新手机,本来想彻底解放双手,结果这位“AI爷”让我气得差点把中控屏砸了。不过话说回来,最近在家里的那一套智能设备上,这玩意儿好像又没那么蠢了。这到底是技术开挂了,还是咱们期待太高了?

我去翻了翻一些行业报告,心里一下凉了半截。原来不光是

而且,咱中国用户的吐槽才是最扎心的。根据艾媒咨询的数据,超过一半的人觉得,现在最该干的事,是把语音识别给我整明白点!特别是在菜市场里那个吵吵闹闹的环境下,或者家里老一辈人说带着浓浓方言口音的时候,这语音助手直接就“死机”了-52。

以前大家觉得,有个AI语音助手智能助手像个“耳背的大爷”,咱耐心点也就算了。但如今,动不动就冒出个号称“情商爆炸”的AI文案、AI画图,回过头来再看手机里那个连“火锅店”都听不明白的老古董,这反差感真的是太搞了。就像刚吃完米其林,你让我马上啃干馒头,我肯定不乐意啊。

行业大佬都在“卷”什么?搞这些花里胡哨的有用吗?

这时候肯定有杠精要说,现在的AI语音不是已经进化到能用大模型改写内容了吗?什么写周报、写邮件,不是早就打通了吗?确实,很多人已经转向了新软件,但靠说话完成工作的场景,还不是咱们每个普通人最直观的“爽点”-13。

为了搞清楚它们到底有没有在进步,我专门盯着家电展看了半天。这才发现,真正的“战火”其实早就不在手机里了,而是在你家。

就拿华为前几天刚推出的鸿蒙智家小艺管家来说,这个AI语音助手智能助手升级到了6.0版本,里面灌入了自家的大模型,现在你跟它说“把沙发旁边那个灯调暗点,再把窗帘关上”,它居然能听懂空间描述,直接给你“说哪亮哪”,不像以前非得背出具体的设备名“灯带一号”,否则它压根不鸟你-61。

关键是有个特别细节的地方——“悄悄话模式” 。我在网上看评测,发现你在半夜蹑手蹑脚想开盏灯,怕吵醒旁边睡觉的老婆孩子,你不用大声吼,只需要压低嗓子,用气声说句话,这个小艺管家也能识别出来,然后用那种超轻柔的声音回应你-61-65。这种细微到情绪和场景的体感,才让人觉得这AI终于不是“冷冰冰的机器人”了,它开始察言观色了。

还有声网那边搞的机器人原型,现在甚至能识别人的手势、人脸轨迹。你给它个眼神,它就知道要看你;你招招手,它就走过来打招呼-23。这就很带感了!等这种技能普及时,咱们就不用担心在家干活时被手机叫个没完,它压根不会打扰你,就像个真正懂眼色的私人管家。

话又说回来,光会卖萌就能解决老大难问题吗?

虽然花活很多,但说到底,“听得清”才是大哥。现在还是有一些数据看着挺吓人,有人测试了市面上几款最热门的全模态大模型在语音交互里“蒙对”的概率,结果发现超过40%!说白了,它压根不是听明白了才回应,而是“猜”出来的-11。如果你正犹豫买不买保险,机器一顿瞎接话,直接就给客户整得不想买了,那这种AI还不如不用呢-11。

好在现在新技术也意识到了这一点。现在的技术已经从早期那种死板的“喊名字”,进化到现在的持续监听、流式理解,甚至不用唤醒,设备就开始自动判断你是不是在跟它说话-21。

给大忙人几句掏心窝子的大实话

这么分析下来,虽然有时候觉得那“人工智障”气得人冒烟,但整个行业其实正在一个“破茧”的阶段。

如果你是个科技懒人,或者家里老人实在玩不转复杂APP,其实可以大胆享受一下。买个支持新AI大模型的智能音箱,或者配一套全屋智能,设定好情景模式。你只要动动嘴“我要出门了”,它帮你关灯关窗扫地。真正能帮我们这些“手残党”把家务做了,这就是大功一件。

至于那些靠语音写长篇大论的办公场景?我试过几次,最终还是回去老老实实敲键盘。因为AI读稿子还行,写东西你喊一句“帮我把这个方案润色一下”,出来的东西常常牛头不对马嘴,真没键盘敲来得实在。

你们肯定也有很多想吐槽的或者想问的,下面我挑三个大家最关心的问题,聊聊我的看法。

网友A(@菜菜不菜啦): 博主,我也买了个带语音助手的智能音箱,但我爸妈说话带严重的口音,那个破音响根本听不懂,气得我老爹差点把音箱摔了。所以我想问,现在的语音助手,是不是还是只听得懂那种超标准的“播音腔”啊?要是有口音咋整?

答: 哈哈,这简直是我在亲戚家串门时的必备“节目”。别担心,这个痛点现在已经被当做头号大问题来解决了。实际上,用户最盼望改进的恰恰是能听懂这种口音和嘈杂环境里的对话-52。你看刚才聊到的华为小艺管家,它内置的降噪技术就是用来对抗周围那些乱糟糟的杂音的-61。行业里还有像科大讯飞那样的公司,一直在拼命收集各种方言的语料训练AI。不过实话实说,现在方言的准确率肯定还没法和标准普通话比。最好的办法是,你跟老人说,用带点“普通话调子”的家乡话,不要说得太生僻和快速,尽量把指令说完整。比如不说“整饭切”,说“我要开始做饭了”。机器现在更多是认词语频率,所以越接近书面表达,它越容易识别,千万别一上来就说特土的俚语,那绝对翻车!

网友B(@开车不摸鱼): 别净说智能家居了,我也知道家里那个好用。但在车里呢?我最近想换个车,特别看重车载语音交互。以前我车里那叫一个难用,唤醒比我的反应还慢半拍。现在的车机系统,那种“喊一次就够,能连续对话不打断”的体验,普及了吗?

答: 问得太是时候了!这绝对是现在汽车厂商内卷的“主战场”。传统那种“你先喊名字,唤醒后再等它反应,再下指令”的方式,确实是上古时代的设计了。如今,顶尖的技术已经淘汰了那种一句一顿的玩法。现在牛掰的技术是“全双工交互” ,就是你说话的时候它就在听,甚至能被你随时打断,它还能根据上文判断你的新指令-22-27。比如你说“导航去万达,哦对了先去加油站吧”,它自己就能调整路线。有些性能强悍的厂商,已经把语音响应延迟压缩到了0.7秒以内,你话还没说完,它就开始执行了-27。但要注意,别被一些厂商的“PPT参数”骗了。你试驾的时候,一定要体验嘈杂环境下的唤醒率(比如把车窗摇下来,开大音乐),还有多轮连续对话(连续说“帮我找最近的充电桩”、“看看那里有几个桩”、“空闲的有几个”)。如果连续三四个问题它都能不重复唤醒就答出来,那才算及格。

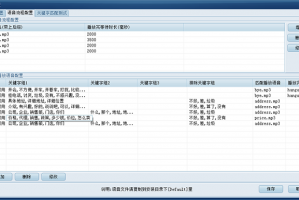

网友C(@科技宅二狗): 老哥,我最近搞了个“智能全屋”,想在每个房间都喊一声“关灯”,不想买那种全屋定制的昂贵方案。有没有那种可以自己DIY,用软件就能把不同品牌的智能设备串起来的AI语音助手?我怕买来没法兼容,变成一堆废铁。

答: 玩全屋DIY,你这种顾虑我太懂了。最怕的就是买了A牌的灯泡,B牌的中控,结果它们“鸡同鸭讲”。现在咱们普通人确实不需要请专门的团队,自己动手丰衣足食就好。想实现跨品牌的智能控制,你得找一个能“居中调度”的智能中枢。像现在一些开放性的平台,比如小米的米家、苹果的HomeKit,或者是一些第三方的全能型AI语音助手,它们最大的优势就是兼容性,能把市面上绝大多数主流品牌的硬件接入进来。最关键的一步是,你在买台灯、插座这些零碎硬件的时候,一定得看清楚产品介绍页是不是写着“支持某某语音助手控制” 。如果不支持,那买回来肯定玩不转。还有个偷懒的诀窍:买同一个大生态(比如全是小米生态链,或者全是支持华为鸿蒙智联)的设备,接进去的时候,不用反复扫码配对,那个中枢就能直接看到你家所有新设备,动动嘴设定场景就行了,特别省心-。以后万一你爸妈来住,说“睡觉了”,你只要在手机上点一下,那一整套关灯、关窗帘、调空调的流程,就全自动运行了。